於 CES 2026,NVIDIA 發表多個軟件功能升級,而針對日益吃重的本機 AI 運算,廠商亦推出「瘦身版」 NVFP4/NVFP8 的模型,並增強整合能力,可更有效率本機生成 AI 短片及圖像等。

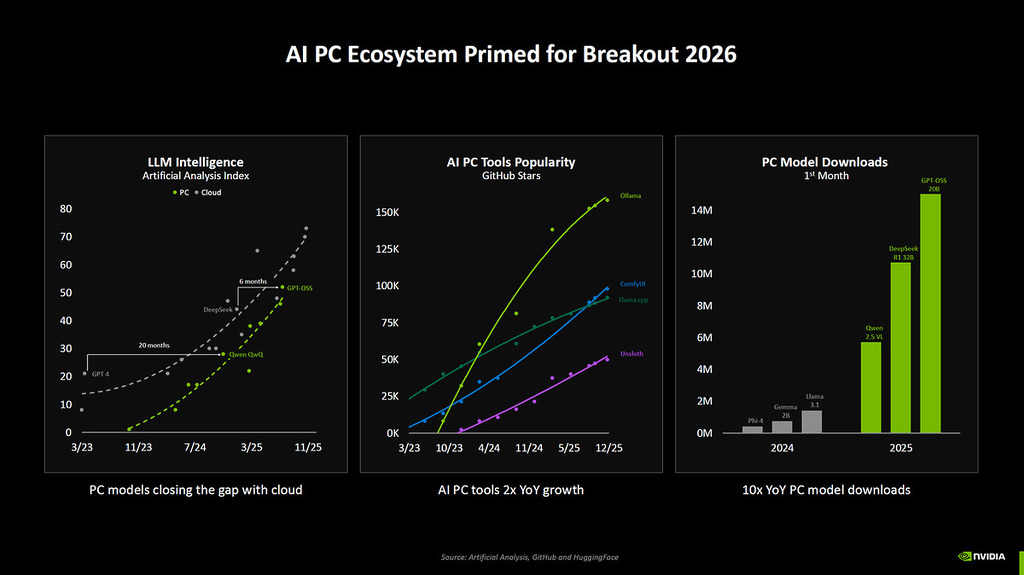

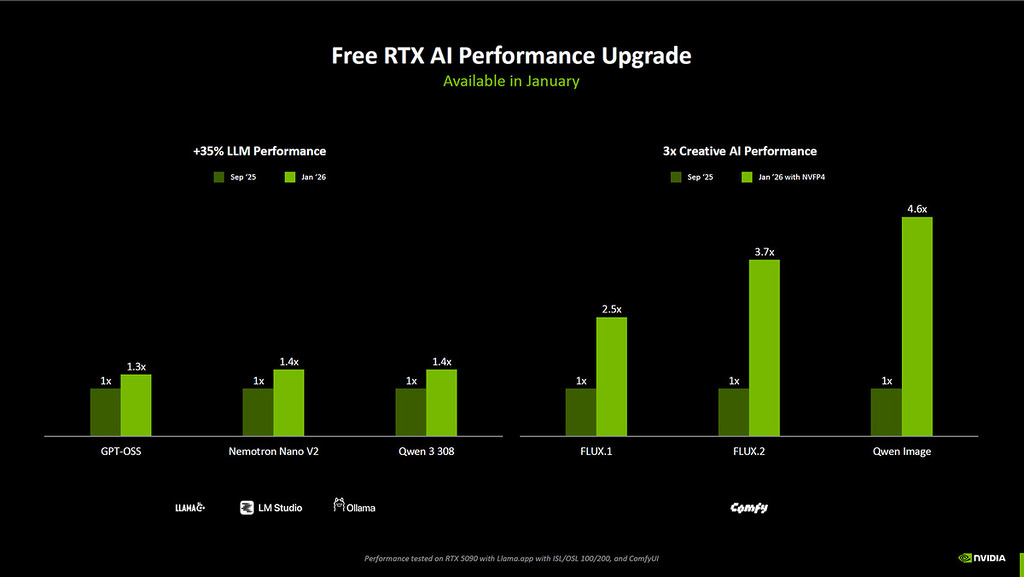

雲端 AI 市場在 2025 年大爆發,但更多玩家已開始在本機搭建運算模型,並不止於圖像生成應用,包括:Qwen、Deepseek、GPT-OSS 20B 等,而且模型對記憶體的需要也愈來愈大,部分要求 32GB 或以上,不是一般 GPU 可負擔。NVIDIA 將會提升 GPU 的 AI 效率,在 LLM 方面平均升 35%,而在創意生成方面更可達 3 倍。

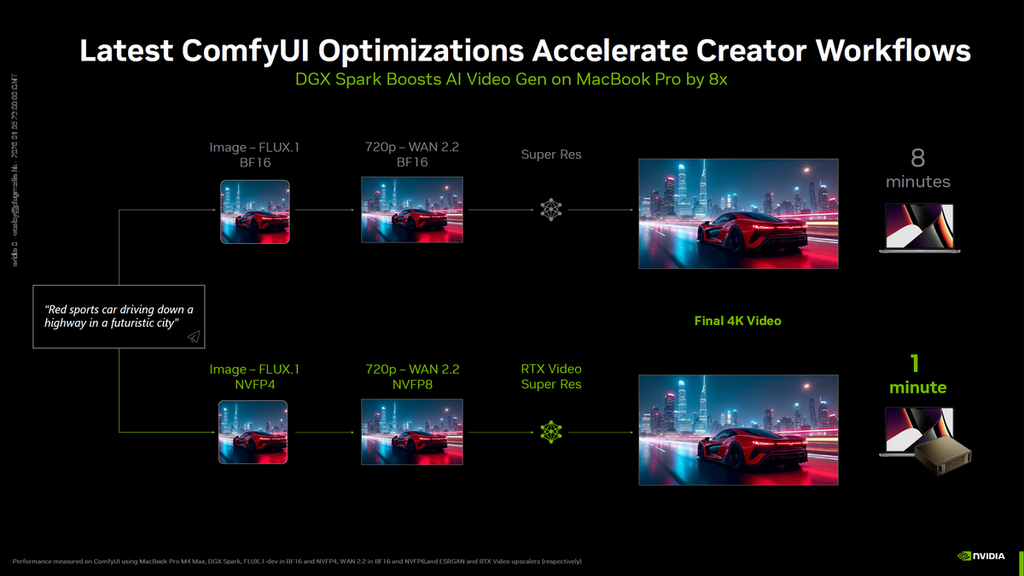

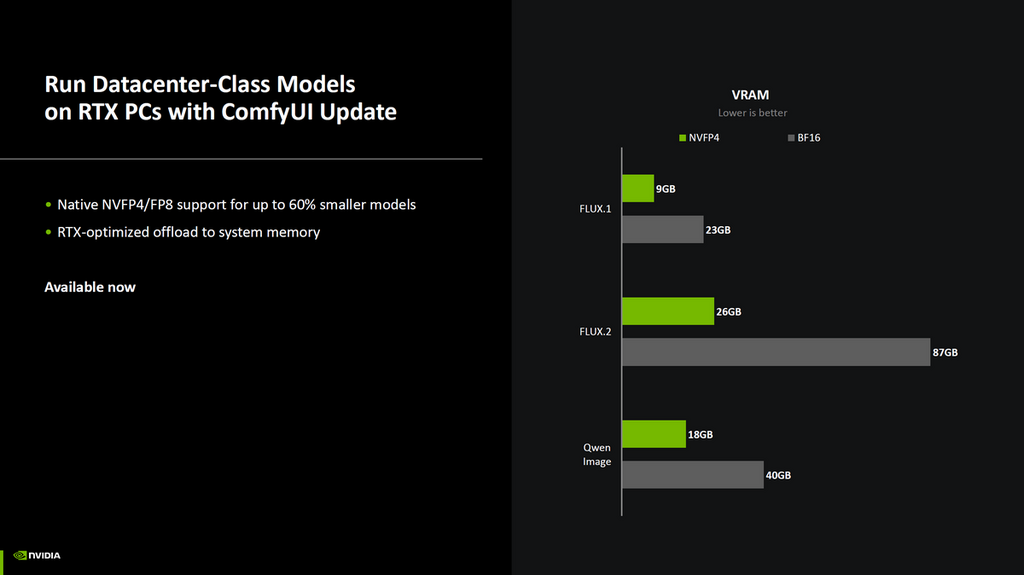

在已經十分流行的《ComfyUI》,會提供「瘦身版」的原生 NVFP4/FP8 模型.模型尺寸最多可縮小 60%,並針對 RTX GPU,可將部分內容分流到主記憶體,減輕 GPU VRAM 需求,舉例 FLUX.1 原有 BF16 模型要 23GB VRAM,改用 NVFP4 即可減至 9GB,FLUX.2 從 87GB 降至 26GB。留意 NVFP8 僅 RTX 40 或以後的 GPU 可用,而 NVFP4 只有 RTX 50 起支援。

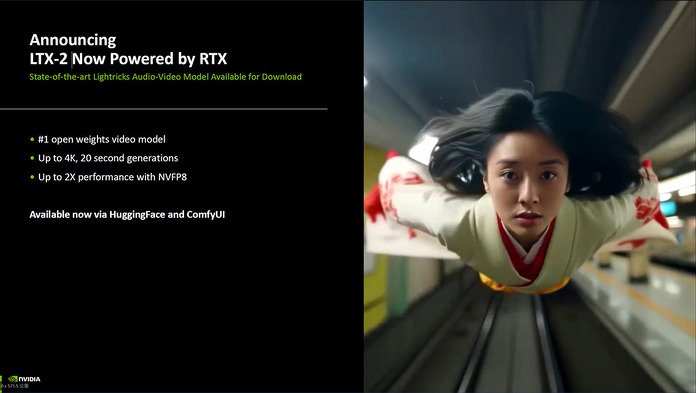

AI 影片生成加速

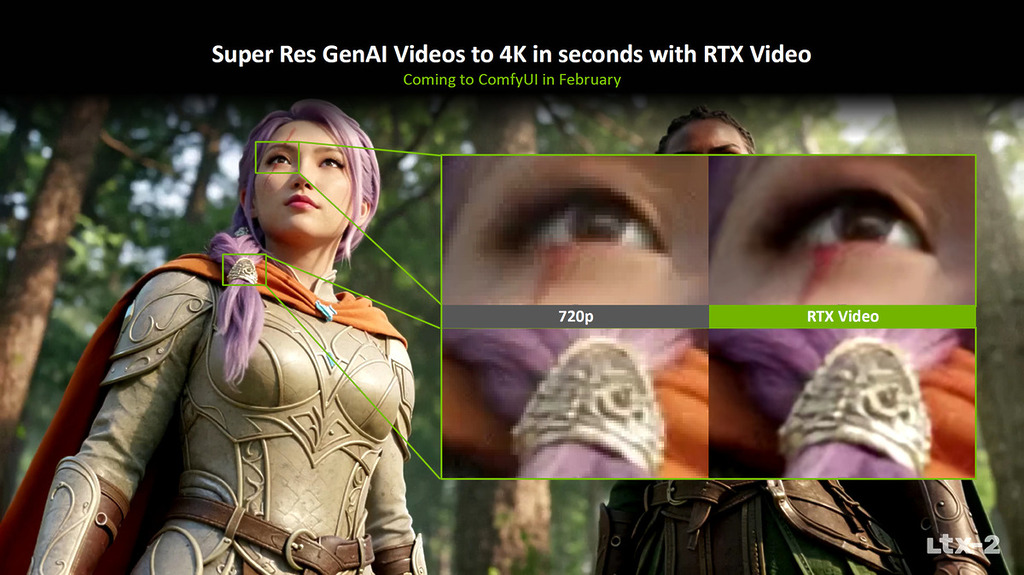

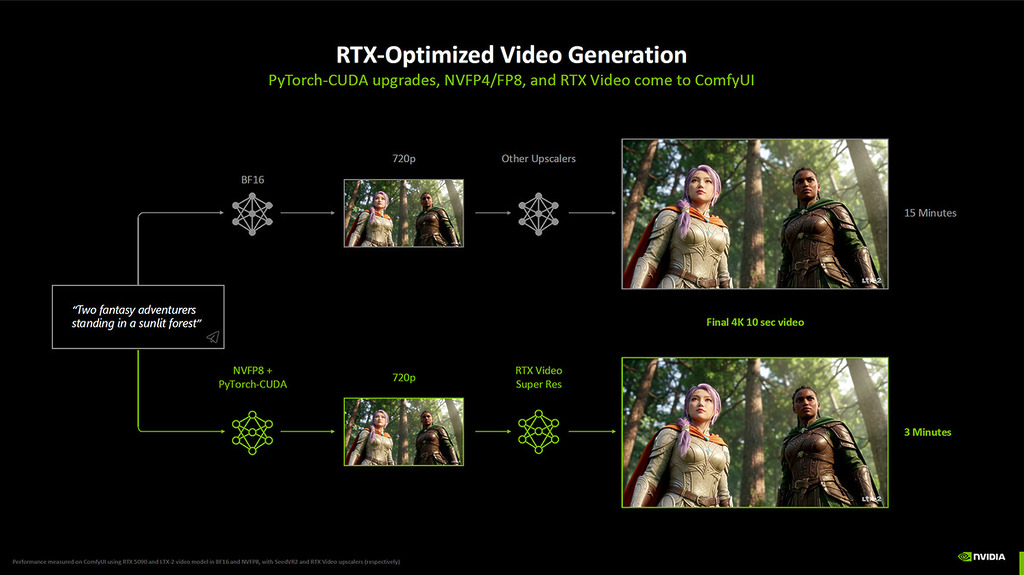

2025 年空橫出現的 AI 影片生成模型 LTX-2,亦支援 RTX 的 AI 加速,將在《HuggingFace》及《ComfyUI》提供,可生成 4K 解像度的 20 秒短片,配合 NVFP8 運算有 2 倍速度改善。同時預告會在 2 月份,為《ComfyUI》生成的 AI 影片提供 RTX Video 渲染升頻,原有 10 秒 4K 短片要 15 分鐘生成,以 720p 渲染升頻可縮短至 3 分鐘。

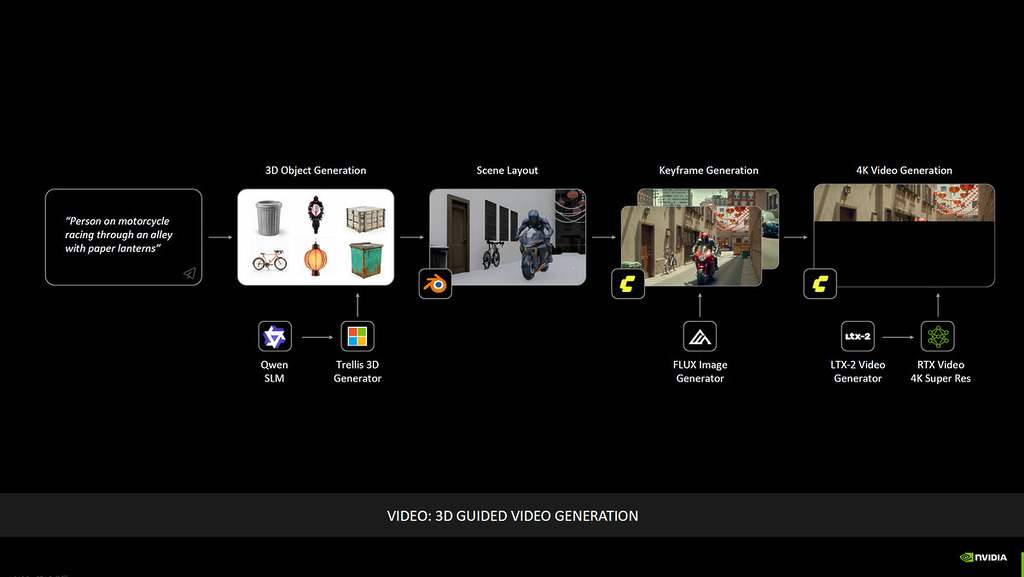

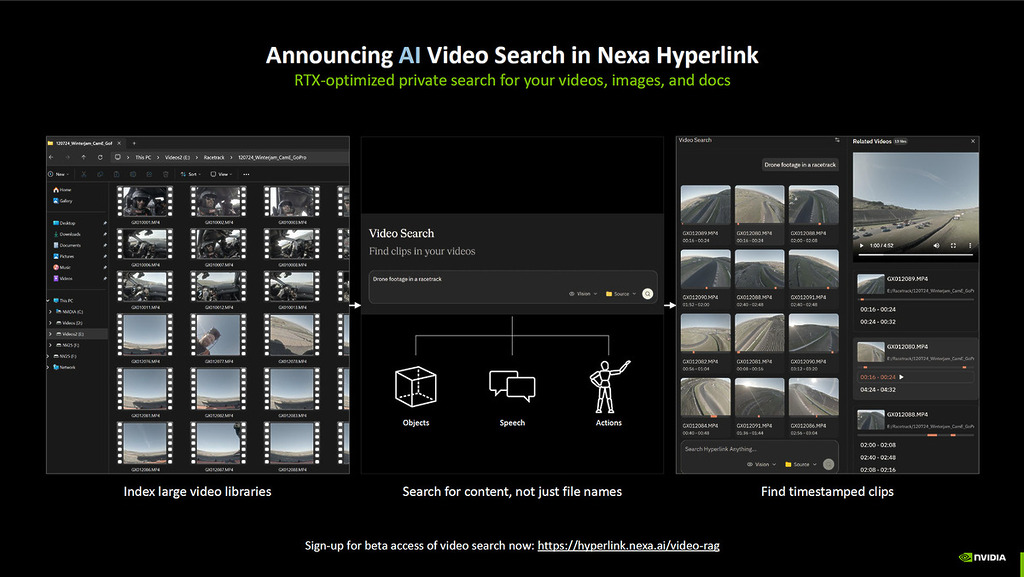

針對 AI 短片生成的不確性低效率,廠商也引入 3D 引導式生成短片功能,用家可用 Qwen SLM/Trellis 3D Generator 等提詞產生基本 3D 物件,在《BLENDER》建立簡單 3D 場景,再以 Flux 產生圖像,最後以 LTX-2 及 RTX Video 生成結果。另為 Nexa Hyperlink 本機 AI 助手,加入 RTX 加速的 AI 影片、圖像及文件本機搜尋功能。

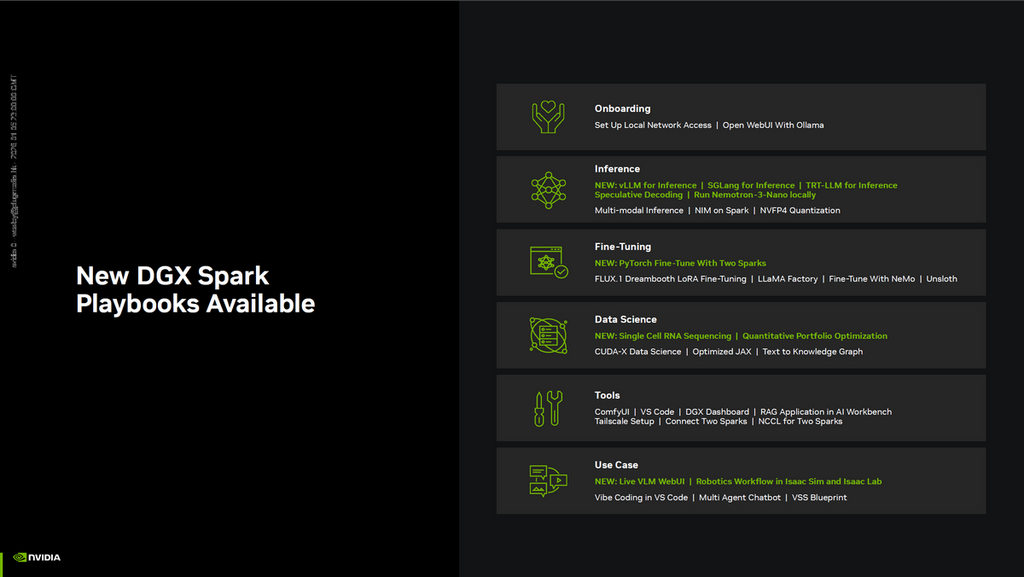

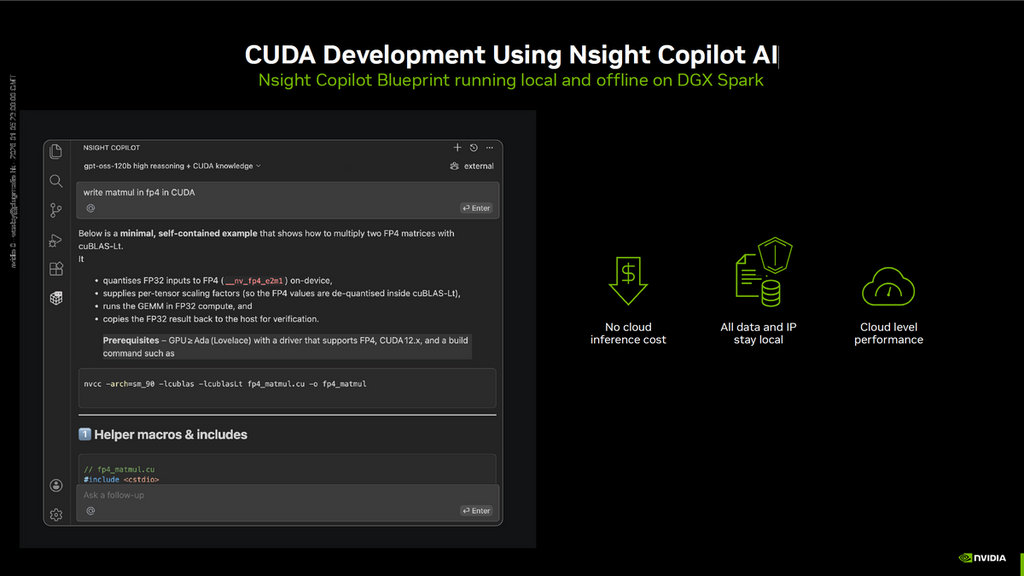

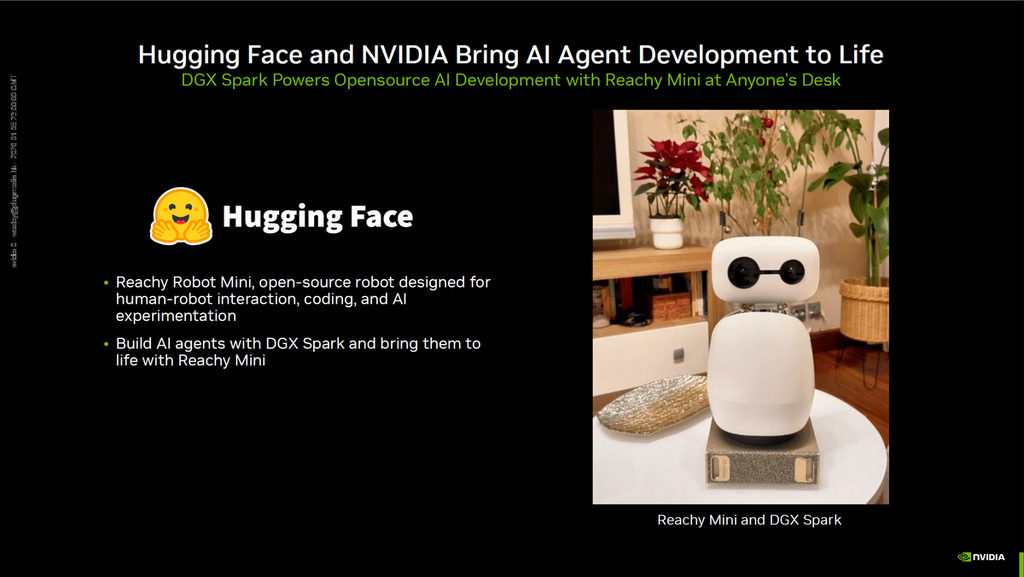

另外,推動代理式人工智能開發的 DGX Spark 平台,亦在 CES 2026 上發表更新內容,支援 NVFP4/FP8 模型,為開源社群應用調校顯著提升效率,發布 7 個新 Playbooks 供 AI 開發者使用;合作夥伴最新工具、框架及模型發布,加速 DGX Spark 上的代理 AI 及創作流程;Hugging Face 與 NVIDIA 合作透過 Reachy Robot Mini 實現 AI 代理;Nsight CUDA 編程開發輔助亦即將支援 DGX Spark;NVIDIA AI Enterprise 將於 1 月底支援 DGX Spark。