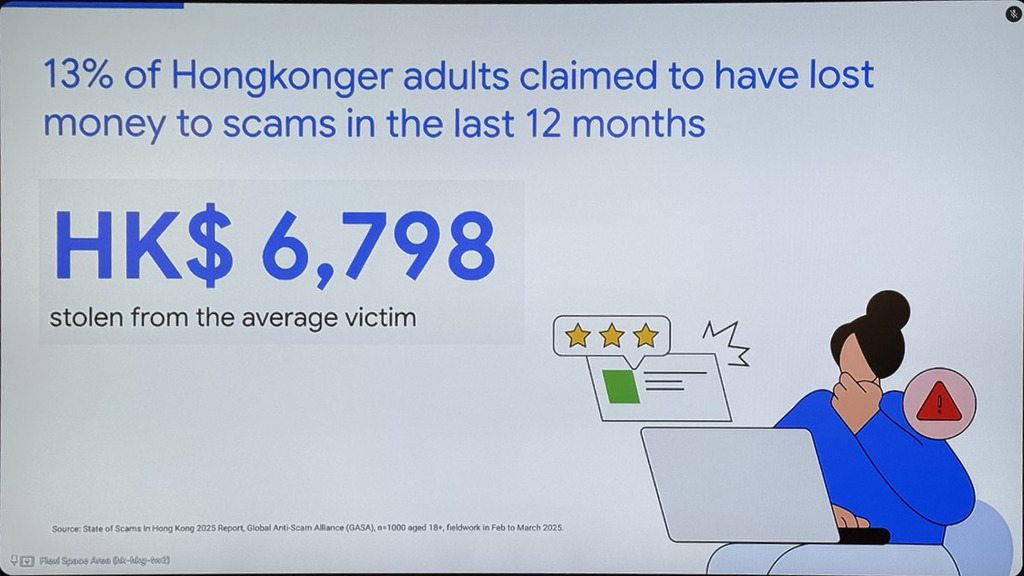

AI 無論在生活或工作上都為我們帶來更多便利,提升生產力。但也同時帶來新的威脅。日前 Google 發表報告,指在過去 12 個月香港每名網絡詐騙受害者平均損失 $6,800,同時向傳媒介紹了他們如何運用 AI 來提升網絡安全,並介紹他們如果與香港社會服務聯會(社聯)合作,提升社福界的網絡安全意識,並支持社福機構安全及負責任地運用 AI 創新。

Google 香港銷售及營運總經理余名德 Michael 分享 Google 如何運用 AI 在全球及在本地層面打擊詐騙,以及如何安全地與 AI 互動或協作。他指雖然 AI 可以助長詐騙規模,但同時也是網絡防禦領域的變革力量。他介紹了一些例子顯示 Google 如何利用 AI 來防禦網絡詐騙。

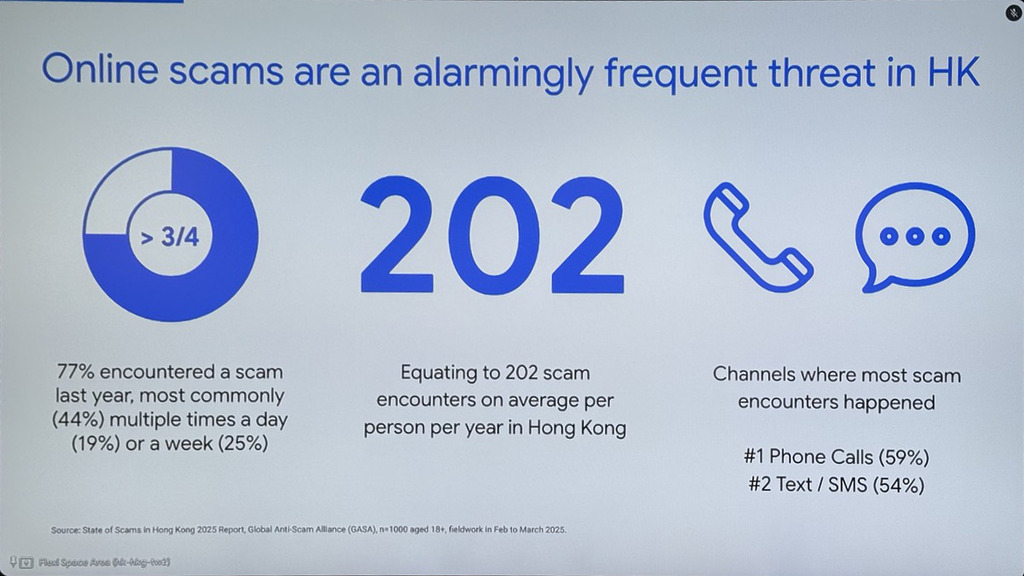

每人每年遭遇 202 次網絡詐騙

Google 是全球反網路釣魚聯盟 GASA 的創始成員。Michael 引述該組織的報告指出 77% 受訪的香港成年人在過去 12 個月內曾經遇上一次或多次網絡詐騙,其中部分人更是頻繁至每星期多次 (25%) 甚至每日 (19%) 都遇上,相當於每人每年遭遇 202 次詐騙。而不法分子最常用來接觸市民的渠道是電話,佔 59%,其次是文字或短訊,達 54%。

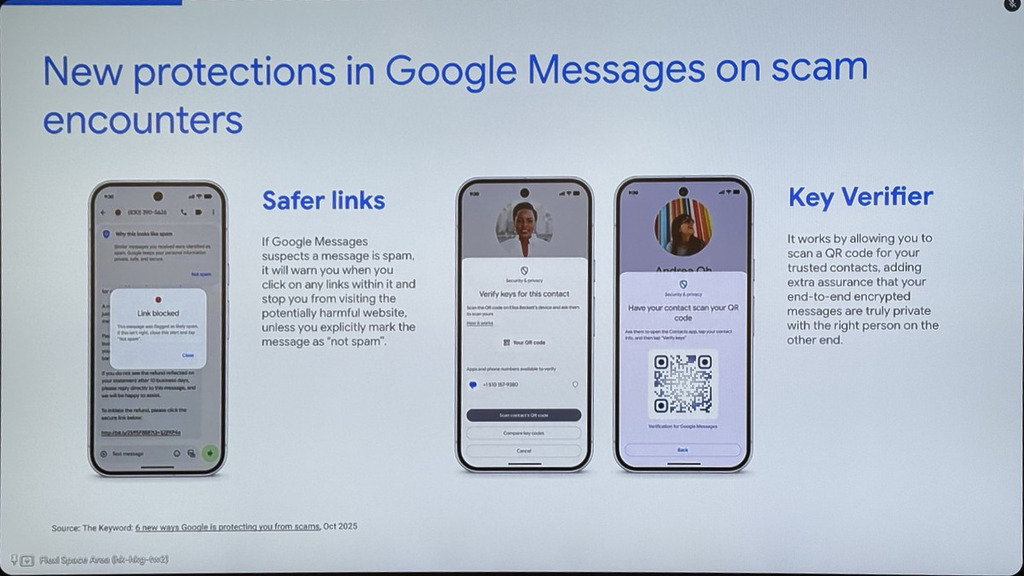

Google Messages 兩項防詐新功能

為防止用戶透過電話與短訊遭遇詐騙,除了「來電顯示與騷擾/廣告來電阻擋功能」及「通話防護等功能 (In-call protections)」外,Google 近期亦在《Google 訊息》App 新增兩項防護功能,分別是「安全連結 (Safer links)」和「金鑰驗證 (Key verifier)」。

「安全連結」是當用戶點擊訊息中任何可疑連結時會發出警告,阻止用戶瀏覽潛在有害網站,除非他們主動將該訊息標記為「不是垃圾訊息」;「金鑰驗證」則讓用戶透過掃描受信任聯絡人裝置上的二維碼,為端對端加密訊息提供額外的安全保證,確保正在與正確的對象通訊。

阻截金融及 AI 偽冒詐騙

調查報告又指 66% 受訪香港成年人在過去 12 個曾遭遇過詐騙陷阱,當中金融投資詐騙和意外之財詐騙最常見的詐騙類型。針對這些詐騙,Google 亦推出應對措施。其中針對金融詐騙,Google 在 2004 年底開始在香港試行 Google Play Protect「強化防詐騙安全防護」功能,這功能會在用戶嘗試從瀏覽器、即時通訊軟件或檔案管理程式等網絡側載來源安裝應用程式時進行分析,一旦發現應用程式可能會存取常被濫用於金融詐騙的敏感權限時,就會主動阻止用戶安裝。據 Google 表示,這功能推出不到三個月,就已在香港堵截了 64 萬次高風險安裝嘗試、當中涉及超過 2 萬個不同應用程式,保護了超過 18 萬部裝置。

另外,騙徒亦利用生成式 AI 來進行詐騙,運用 AI 深度偽造技術,模仿可信人士的影像或聲音。針對利用 AI 偽冒公眾人物的廣告,Google 組建了一支由逾百名專家組成的專責團隊,分析詐騙手法並制定有效對策,包括修訂《不實陳述或行為》政策,暫停宣傳這類詐騙的廣告商帳戶,結果永久暫停了超過 70 萬個違規廣告商帳戶,令 2024 年該類廣告的舉報數量大減 9 成。此外,Google 又為相關的大型語言模型推出超過 50 項強化措施,以更有效率執行政策,阻止了數 10 億條違反政策的廣告接觸到消費者。

運用 AI 堵截生成式 AI 漏洞

除了為用戶提供保護之外,Google 也在開發者層面作出預防,開發支援開發者與企業推動安全創新的 AI 工具,運用 AI 在不法分子利用漏洞前進行修復。

Google 在 10 月推出名為 CodeMender 的 AI 驅動代理,利用 Google AI 模型的先進推理能力,能自動偵測並修復關鍵漏洞。在過去 6 個月 Google Deep Mind 團隊開始開發以來,CodeMender 就已經向開源項目提交了 72 個安全修復方案,其中包括擁有多達 450 萬行程式碼的專案。

生成式 AI 系統的另一項安全漏洞在於「間接提示詞注入 (Indirect prompt injections)」攻擊。網路犯罪者可能利用此手法隱藏惡意程式碼與指令,誘使 AI 執行其指令。例如犯罪者可能會在郵件中植入隱藏指令,當您要求 AI 摘要郵件內容時讓 AI 去執行。隨著企業開始部署 AI 代理程式,此類攻擊的風險將持續攀升。

為此,Google 正透過自適應評估與對抗性訓練,使 Gemini 具備內在抗擊能力。同時由人類紅隊專家團隊 (red teams) 持續測試 Gemini 的防禦機制,在網路犯罪者利用漏洞前,主動修復並發現潛在缺陷。

另外,Google 又推出新的 AI 漏洞獎勵計劃 AI VRP。這計劃由現有的漏洞獎勵計劃發展出來,明確界定了適用範圍內的 AI 相關問題,以激勵研究人員發現並回報重大缺陷。

Google 又擴展了安全 AI 框架 2.0,以因應自主 AI 代理程式所急速引發的新興風險。

SocSmart AI 聊天機械人助本地社福機構人員

Google 認為除了運用 AI 來大規模抵禦外部威脅外,還需要與當地夥伴協作,協助組織管理內部風險並落實創新責任。在香港,Google 與金融監管機構、科技及電訊業合作參與《保障消費者防詐騙約章 3.0》,還持續拓展與香港社會服務聯會的長期合作關係,以共同打擊網詐騙。

今年 Google 已培訓逾 400 名非政府組織及社福機構人員,在網絡安全與負責任 AI 應用領域的培訓人數較去年增長 1.5 倍。在今次分享中 Google 就請來香港社會服務聯會總監(善用科技)何美儀女士和 NGO 代表循道衛理觀塘社會服務處資訊科技主任陳冠庭先生分享如何在社福界安全地運用 AI 解決問題。

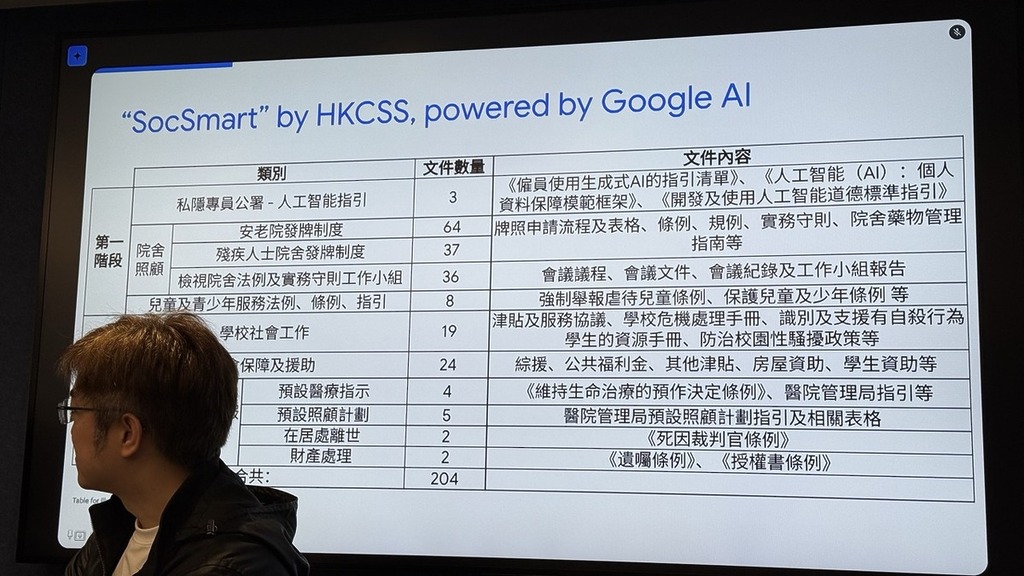

何美儀表示很高興進一步深化與 Google 的合作,不單為業界提供網絡安全和負責任 AI 培訓,更擴展至 Google AI 應用場景的探索與試行。在上月舉行的「社創及科技研討會 2025」中,社聯就宣布利用 Google AI 模型開發了一款 AI 聊天機械人「SocSmart」,以與社福界日常工作最為相關的政策和手冊作訓練,目標是為社福機構及人員提供一個安全可靠的平台,以便在需要時快速查詢相關政策和條例的詳情和更新。SocSmart 預計 11 月底就會推出測試版。

陳冠庭亦透露他們參與了與 Google 合作的試行工作坊,運用企業版 NotebookLM 進行內部試驗,例如以機構人事部文件進行訓練後,查詢有關員工請假的事宜都能直接回覆,效果非常理想,減省不少行政工作。

安全及負責任運用 AI 實用貼士

AI 日漸融入生活日常和工作,但同時也帶來挑戰和需要考量的地方,例如 AI 可能會出現「AI 幻覺」的錯誤。要安全而負責任地運用 AI,Google 就分享了一些貼士。

對於機構部署 AI 時應考慮:

- 評估 AI 系統在每次互動中的公平性,因為底層模型可能經常變化;

- 注意潛在的 AI 偏見;

- 提倡評估 AI 產品和解決放案的團隊應具包容性;

- 倡導 AI 應具更高的透明度和問責制

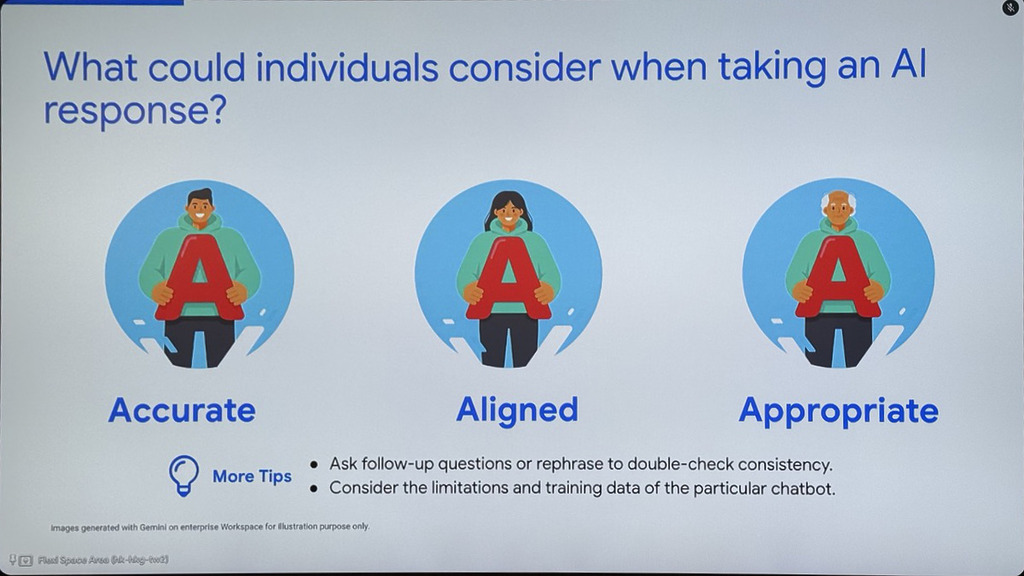

個人方面,Michael 就介紹了一個「AAA」框架來評估 AI 回應,包括:

- 準確性 (Accuracy):評估 AI 的陳述是否能以可靠來源作驗證,而其邏輯和推理是否合理;

- 一致性 (Alignment):審視回應是否直接回答問題、切合主題,並有效地推進對話;

- 合適性 (Appropriateness):考慮回應內容及用語是否與該情境相符及合適。

用戶又可以視情況提出追問或重述問題,以反覆驗證內容的一致性,並應將特定 AI 聊天機械人的局限性及訓練數據納入考量。

最後,Google 又分享了一些實用貼士,助大家在不同場景都能安心上網:

- 僅透過官方且信譽良好的平台或經核實的網站進行捐款和購物;

- 務必透過公司的官方網站獲取資訊,仔細檢查網站是否有細微的拼寫錯誤、奇怪的格式、不尋常的字體或隨機的表情符號等——這些都可能是虛假網站的警號;

- 對任何承諾保證或極高回報而風險很低或沒有風險的投資保持懷疑。如果聽起來好得難以置信,那很可能就是假的;

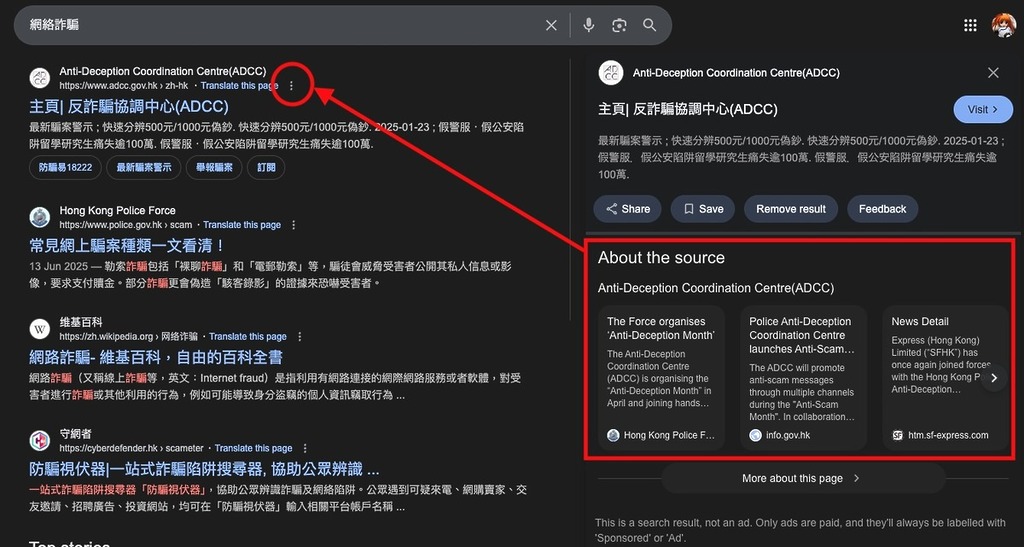

- 點擊 Google 搜尋結果或圖片旁的「三點圖示」,分別查看「關於此結果」和「關於此圖片」功能,以深入了解資訊來源。